La maturité des équipes (Partie 2/2) – Implémenter les Evaluations en 6 étapes

Dans la première partie de cette série consacrée aux évaluation de maturité des équipes, nous avons présenter pourquoi il est important de mesurer la maturité des équipes et des organisations et pourquoi cela n’est pas encore assez déployé dans les entreprises – La maturité des équipes (Partie 1/2) – L’angle mort des organisations.

Dans cette second partie je vous propose d’explorer comment mettre en place les évaluations de maturité, en 6 étapes.

Etape 1 – Choisir les bons éléments à mesurer

L’erreur classique est de vouloir tout évaluer d’un coup. Une grille de 200 assertions couvrant tous les domaines imaginables découragera n’importe quelle équipe. Commencez par vous poser une question simple : quels sont les deux ou trois domaines où l’amélioration aurait le plus d’impact pour cette équipe, aujourd’hui ?

Partir des douleurs concrètes

Si l’équipe souffre de problèmes de qualité en production, commencez par une évaluation des pratiques techniques et DevOps. Si les sprints se terminent systématiquement avec du travail non achevé, évaluez la maturité agile/scrum et la gestion du flux. Si les relations avec les parties prenantes sont tendues, analysez la maturité organisationnelle et fonctionnelle de votre équipe.

L’évaluation doit répondre à une problématique perçue par l’équipe, pas à une exigence bureaucratique du management.

Dimensionner les grilles

Une bonne grille d’évaluation comprend entre 20 et 50 assertions. En dessous, elle est trop superficielle pour être utile. Au-dessus, elle devient illisible et désengageante pour l’équipe.

Chaque assertion doit être formulée de manière concrète et observable. Évitez les formulations vagues comme « L’équipe est agile ». Préférez des assertions précises : « L’équipe visualise l’intégralité de son flux de travail, de la demande à la livraison », « L’équipe limite explicitement son travail en cours (WIP) et respecte ces limites », « Les tests automatisés sont exécutés à chaque commit », …

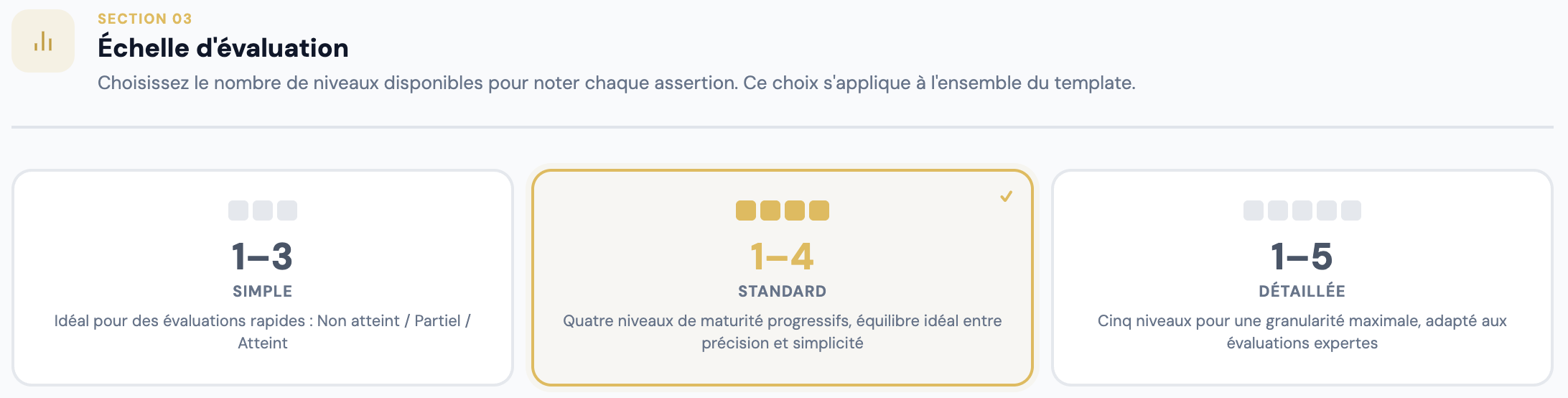

Définir les niveaux de maturité

Pour chaque assertion, vous devez évaluer le niveau atteint. Les échelles les plus courantes utilisent 4 à 5 niveaux. Par exemple : Non applicable, Initiation, Adoption, Optimisation. Ou encore : Non pratiqué, Informé, Appliqué, Maîtrisé, Optimisé.

Tout le monde doit comprendre, clairement, à quel niveau se situe l’équipe.

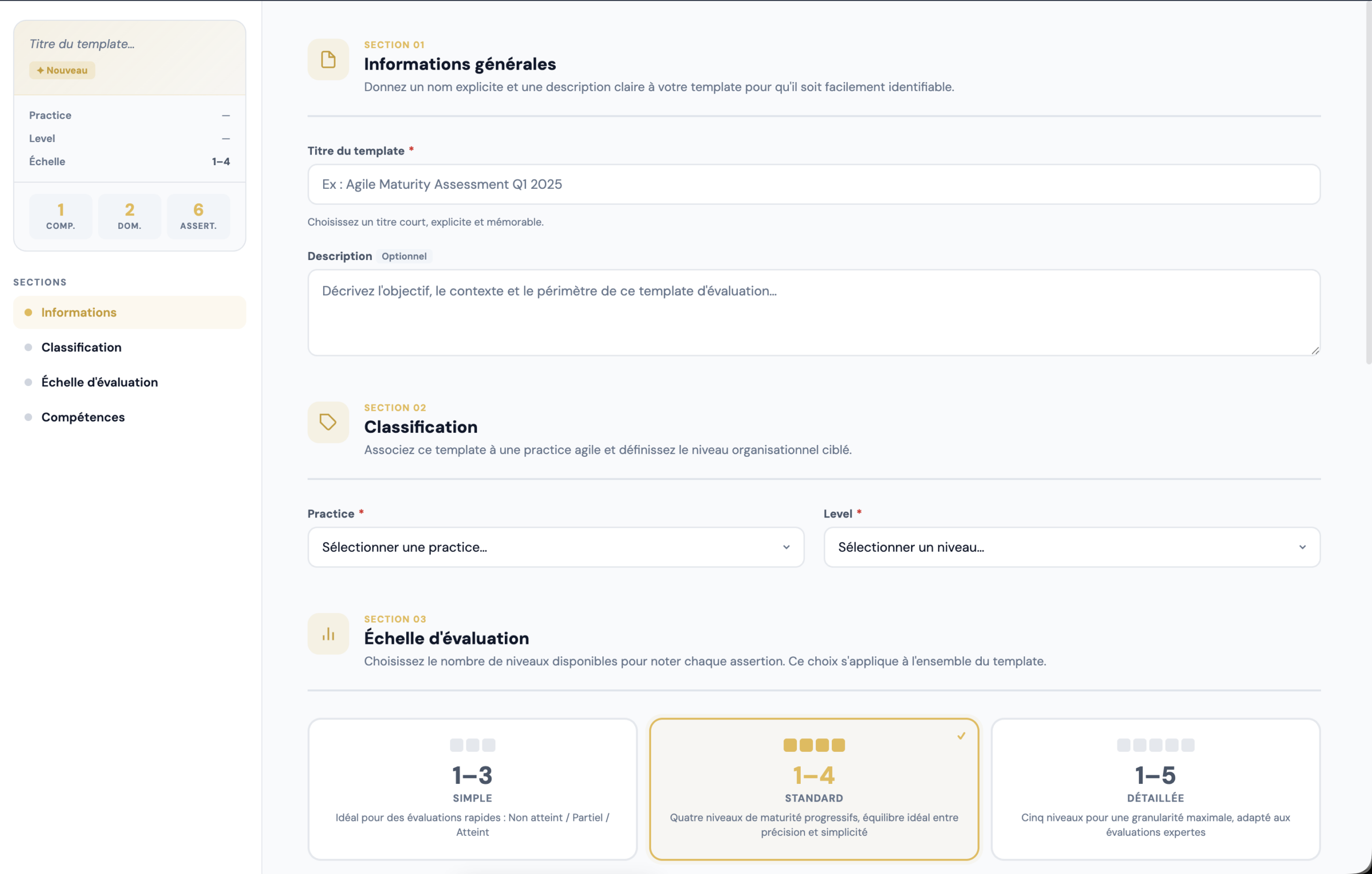

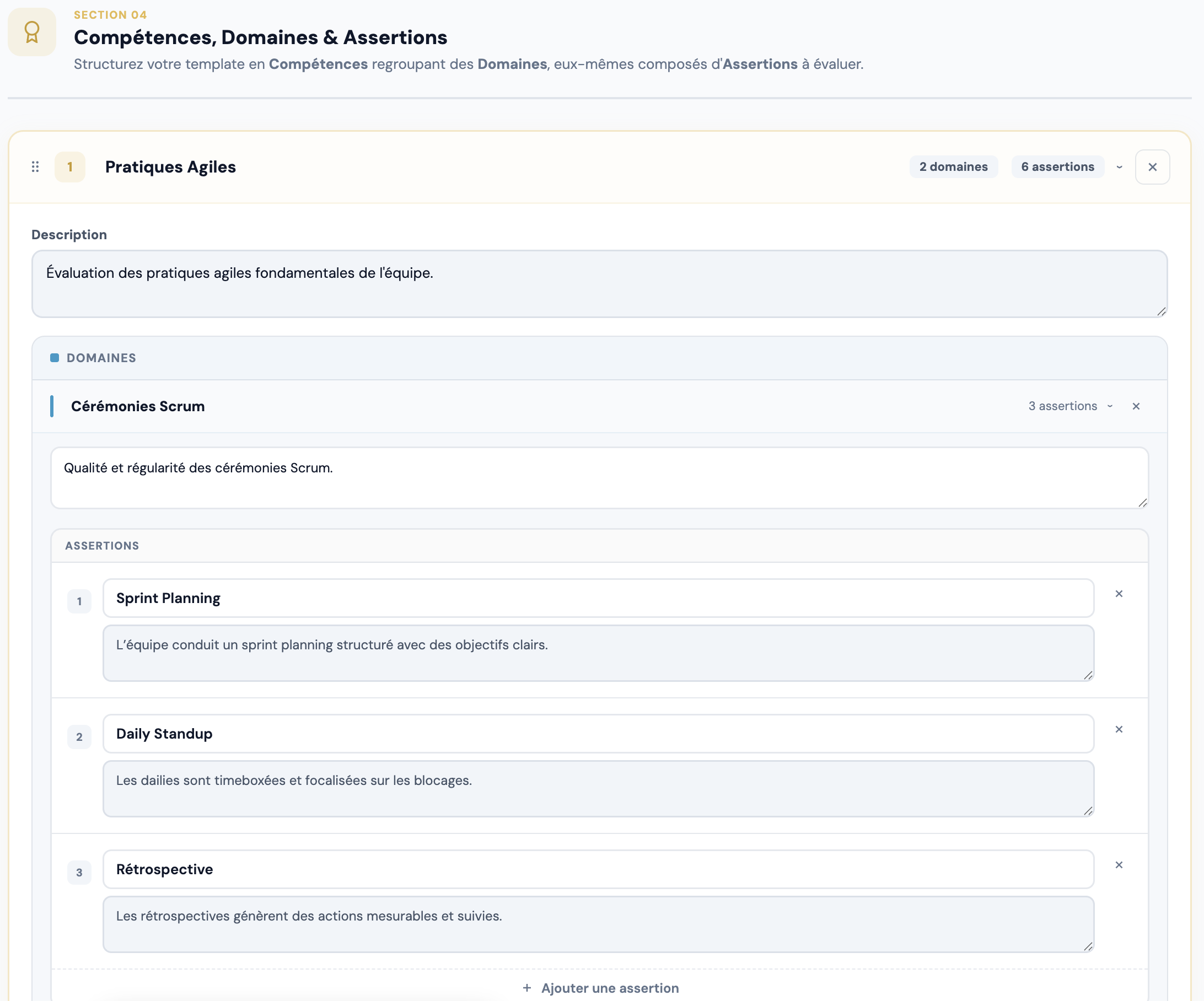

Dans Flow Analytics Pro, une grille d’évaluation est structurée en trois niveaux : les Compétences (grands domaines comme « Visualiser le travail » ou « Intégration continue »), les Domaines (sous-catégories au sein de chaque compétence) et les Assertions (les items concrets à évaluer). Cette structure arborescente permet de créer des grilles aussi simples ou aussi détaillées que nécessaire. Chaque grille peut être associée à une pratique (Kanban, Scrum, DevOps, etc.) et à un niveau d’évaluation (équipe, programme, organisation).

Étape 2 — Impliquer l’équipe dans l’évaluation

Une évaluation réalisée par le manager s’apparente souvent à est un audit. Une évaluation réalisée par l’équipe elle-même (auto-évaluation) est un véritable outil d’amélioration continue. La différence est fondamentale.

L’auto-évaluation : le format à privilégier

Le format le plus efficace est l’auto-évaluation collective. L’équipe se réunit (comptez 1 à 2 heures selon la taille de la grille), parcourt chaque assertion et discute ensemble du niveau atteint. Une personne joue le rôle d’animateur/facilitateur (Coach Agile, Scrum Master, autre), mais c’est l’équipe qui tranche sur son niveau de maturité. Le facilitateur peux bien sur challenger le choix du niveau de maturité.

Ce format a trois avantages :

- Il crée de l’appropriation – les résultats sont ceux de l’équipe, pas ceux d’un évaluateur externe ou du manager ;

- Il génère des discussions riches – les désaccords sur le niveau atteint révèlent souvent des perceptions différentes au sein de l’équipe, ce qui est déjà une information précieuse.

- Il rend la mesure moins « institutionnelle » – l’équipe comprend qu’il ne s’agit pas de la noter, mais de prendre un instantané pour savoir où progresser.

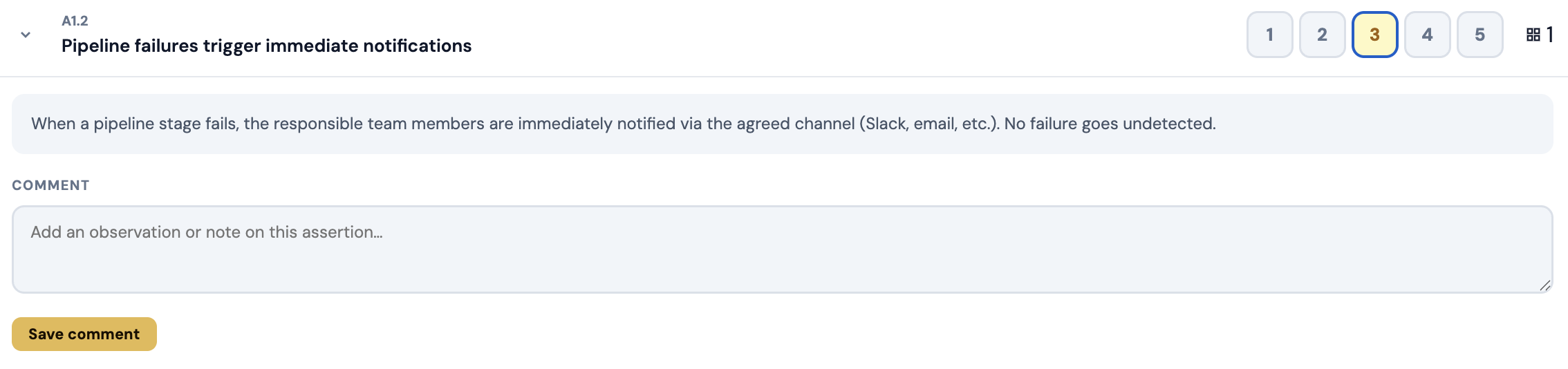

Utiliser les commentaires pour contextualiser

Pour chaque assertion évaluée, prenez le temps d’ajouter des commentaires. Pourquoi l’équipe se situe-t-elle à ce niveau ? Qu’est-ce qui manque pour atteindre le niveau suivant ? Y a-t-il des blocages externes ? Ces commentaires seront précieux lors de la construction du plan d’action.

Une auto-évaluation est-elle fiable ?

Clairement, c’est la question que tout le monde se pose lors d’une séance d’auto-évaluation. qu’est ce qui garantie l’honnêteté de l’équipe dans son évaluation ? D’autant plus dans un environnement laissant peu de place au droit à l’erreur et à la bienveillance.

Ce risque est bien réel, mais il diminue fortement si le cadre est bien posé. L’équipe doit comprendre qu’un score élevé sans réalité derrière est contre-productif. Les actions d’amélioration seront mal ciblées et les résultats décevants.

Mieux vaut un 45% honnête qui déclenche les bonnes actions qu’un 80% flatteur qui ne change rien.

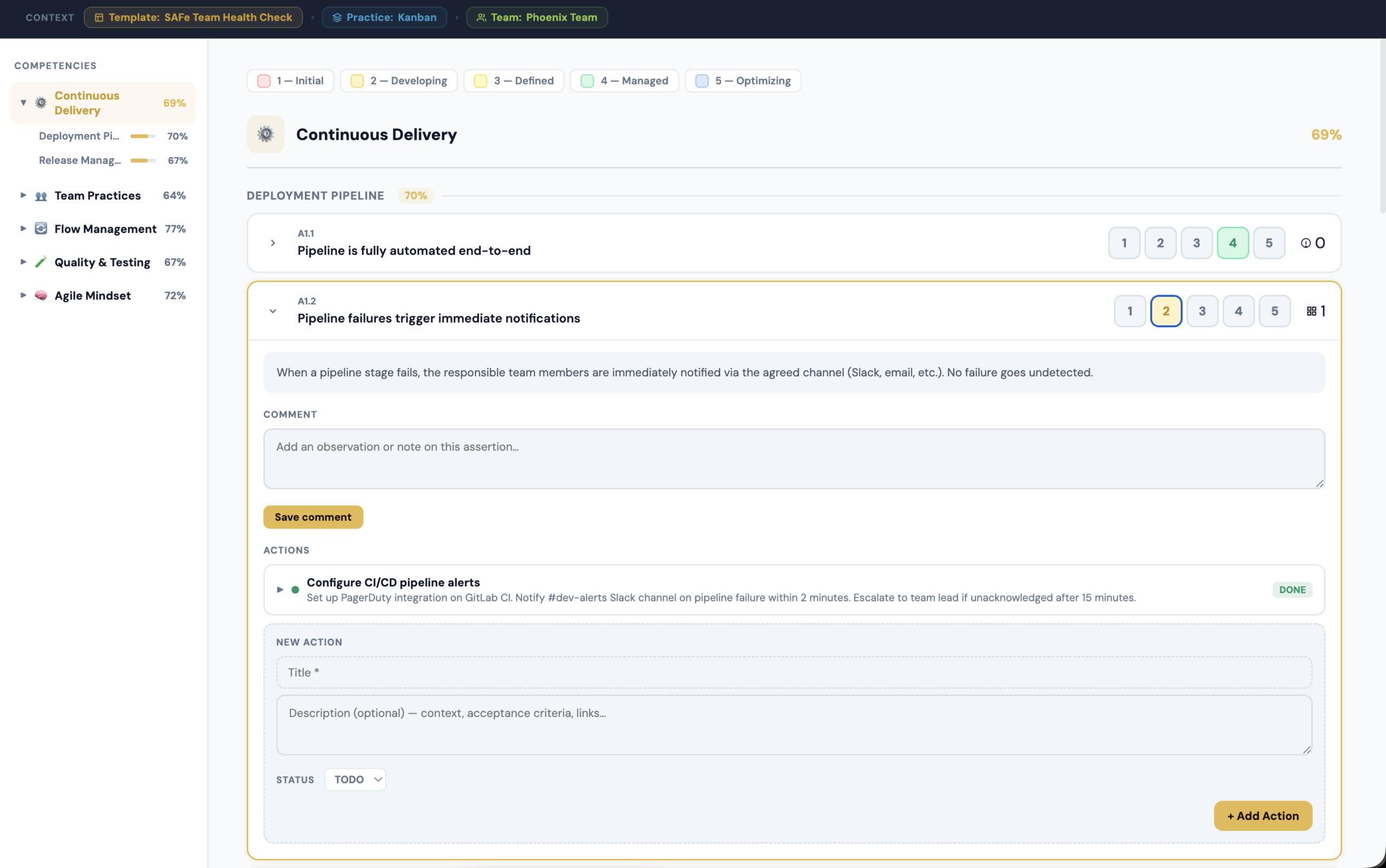

Flow Analytics Pro permet de réaliser les évaluations directement dans l’outil, assertion par assertion. Pour chaque assertion, l’équipe sélectionne le statut atteint et peut ajouter des commentaires détaillés. Le score global est calculé automatiquement, ainsi que le score par compétence et par domaine. L’évaluation peut être réalisée en séance collective (l’écran est partagé en salle) ou individuellement puis consolidée.

Étape 3 — Transformer les résultats en plan d’actions

C’est souvent le parent pauvre et un critère d’échec des évaluations. La mesure est faite, le radar est produit, tout le monde valide et … rien ne se passe.

Pour éviter cette situation, démotivante pour l’équipe, les actions d’améliorations doivent identifiés durant l’évaluation et rigoureusement suivies dans leur réalisation.

Traiter 2-3 priorités à la fois, pas plus

L’évaluation va probablement révéler des dizaines de points d’amélioration potentiels. Ne cherchez pas à tout traiter en parallèle. Comme vous le faites pour les sujets à traiter dans votre flux de travail, priorisez les 2-3 actions prioritaires à traiter, traitez les, valider le résultat et ensuite passez aux 2-3 actions suivantes, …

Les bons critères de sélection peuvent être :

- l’assertion est proche du niveau supérieur (le gain est atteignable) ;

- elle a un effet de levier sur d’autres assertions (par exemple, améliorer les tests automatisés impacte la qualité, la confiance dans le déploiement et la fréquence de livraison) ;

- l’équipe est motivée pour y travailler.

Formuler des actions concrètes

« Améliorer nos pratiques de test » n’est pas un plan d’action. « Mettre en place un pipeline de tests unitaires qui s’exécute à chaque push sur la branche principale, d’ici la fin du mois » en est un. Chaque action doit être spécifique, avoir un responsable et une échéance.

Le nombre d’actions par assertion doit rester limité : une à trois actions maximum. L’objectif est d’avancer pas à pas, pas de produire un plan de transformation à 50 lignes.

Rattacher les actions au quotidien de l’équipe

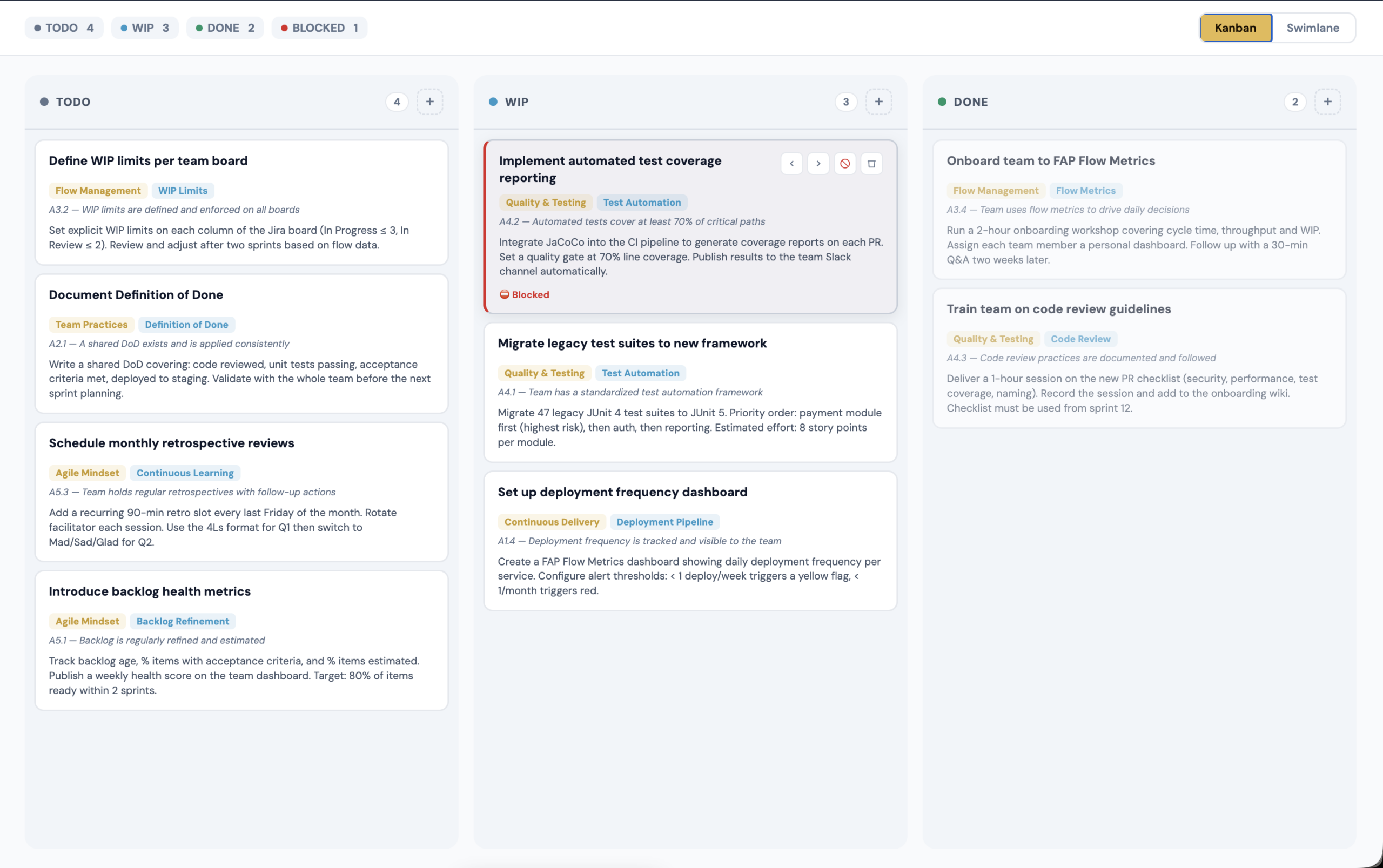

Les actions d’amélioration ne doivent pas vivre en dehors du flux de travail. Intégrez-les comme des tickets dans votre backlog, avec la même visibilité et le même suivi que n’importe quel autre travail. Si l’amélioration n’a pas sa place dans le board de l’équipe, elle n’existera pas.

Flow Analytics Pro — chaque assertion évaluée peut être associée à des tâches d’amélioration directement dans l’interface. Ces tâches ont un statut de progression (À faire, En cours, Terminé) et sont rattachées à l’assertion concernée. Lors de la prochaine évaluation, vous pouvez voir immédiatement quelles actions ont été réalisées et quel impact elles ont eu sur le niveau de maturité. Ce lien direct entre la mesure et l’action est la clé pour sortir du syndrome de l’évaluation qui ne sert à rien.

Étape 4 — Historiser et mesurer la progression

Une évaluation ponctuelle donne une photographie à un instant T. Plusieurs évaluations dans le temps permettent de suivre la progression de la maturité de l’équipe et les résultats obtenus.

Définir un rythme de ré-évaluation

Trop fréquent et l’évaluation devient une corvée ou les actions d’amélioration n’ont même pas le temps d’être mises en oeuvre (frustrant pour l’équipe). Trop espacée et l’équipe perd la maitrise de son amélioration continue.

Un rythme trimestriel est un bon point de départ pour la plupart des équipes. Il laisse suffisamment de temps pour mettre en œuvre les actions d’amélioration et en constater les effets, sans que l’exercice ne devienne routinier.

Comparer avec la mesure précédente

Chaque nouvelle évaluation doit être comparée à la précédente. Quelles assertions ont progressé ? Lesquelles ont stagné ? Y en a-t-il qui ont régressé ? Cette comparaison permet de rendre la progression tangible et d’identifier les actions qui ont portées leurs fruits.

C’est aussi un moment de vérité. Si l’équipe a investi du temps sur une assertion sans que le niveau ne bouge, c’est le signe que les actions n’étaient pas les bonnes ou qu’un blocage externe persiste. Cette lucidité est précieuse.

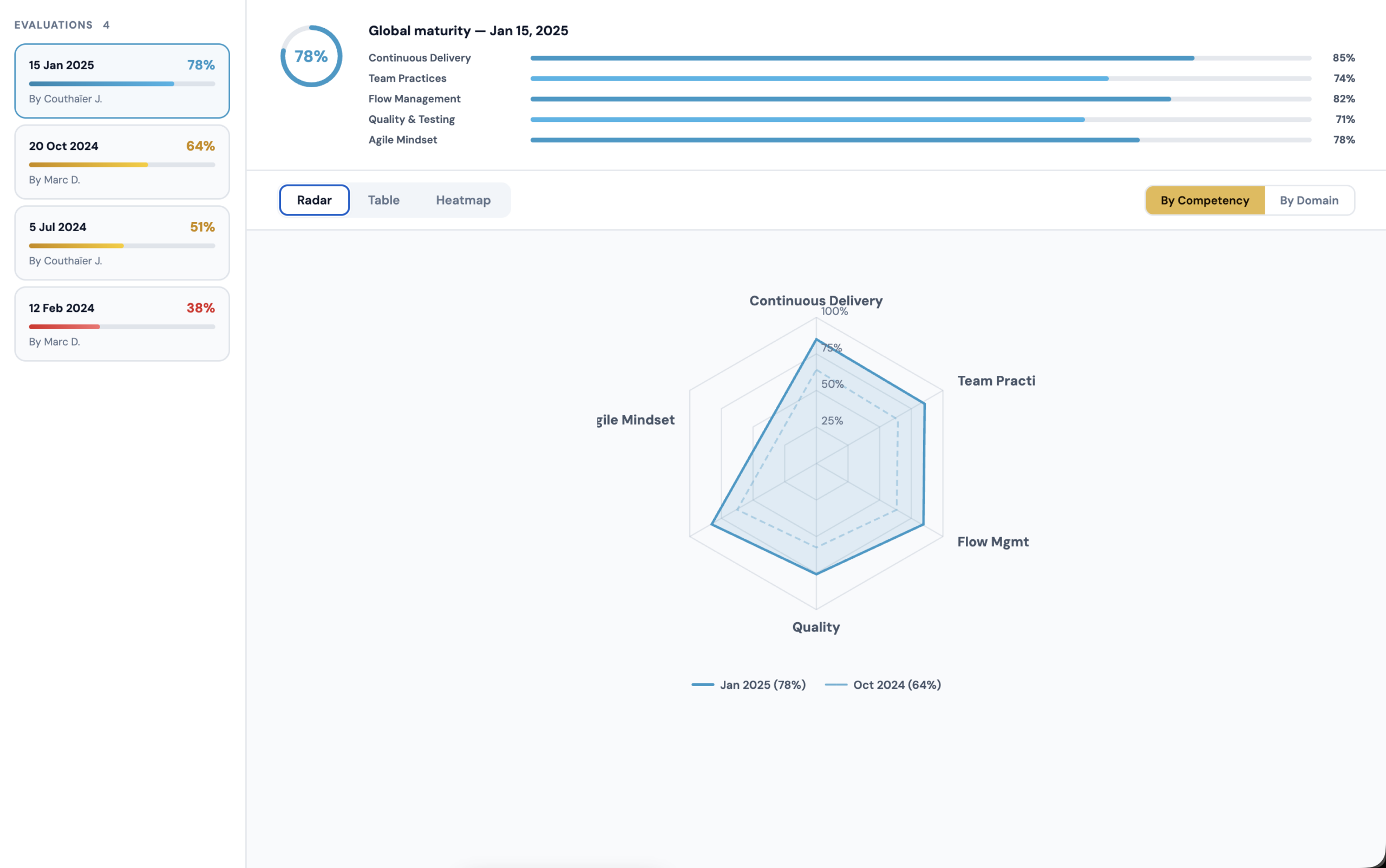

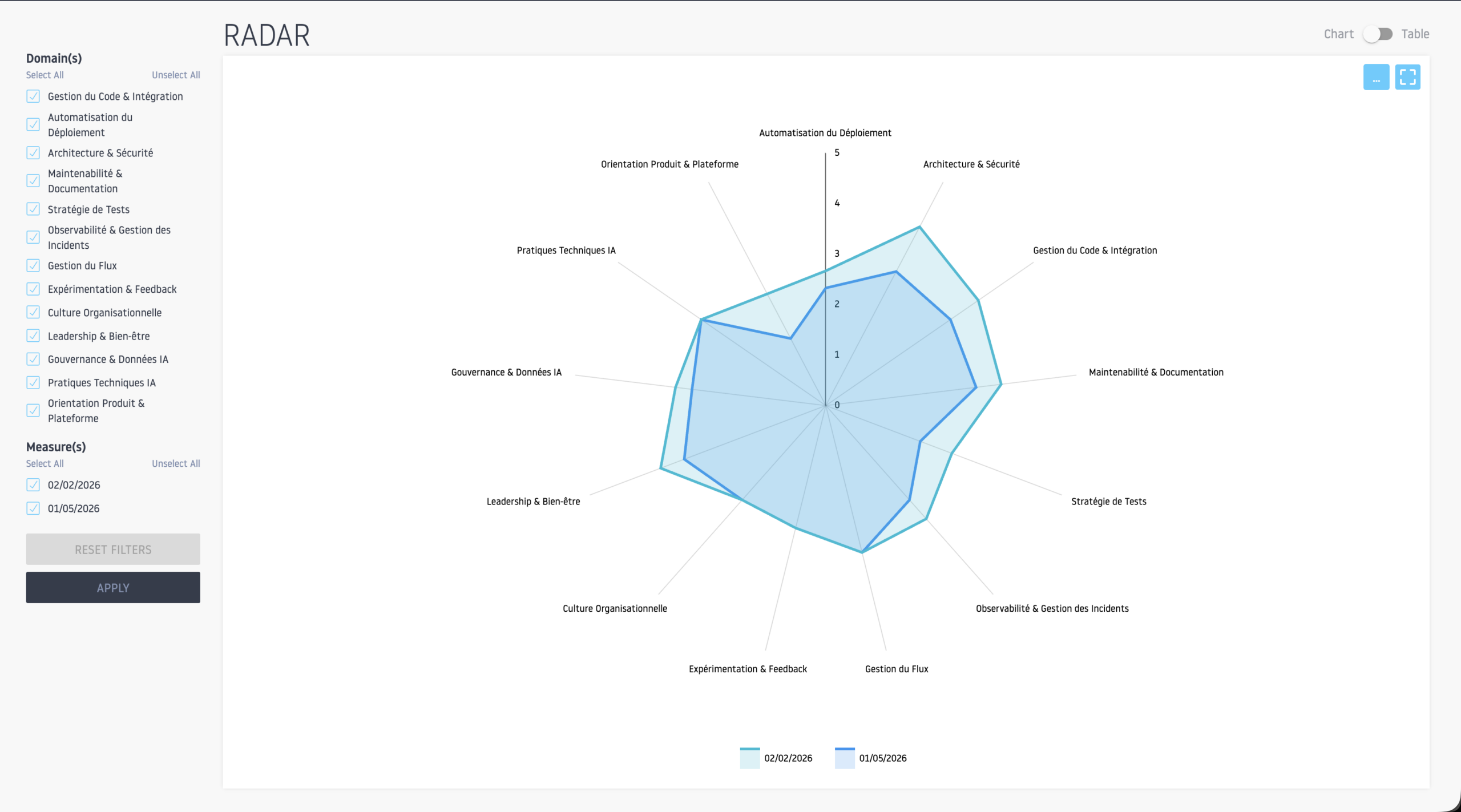

Le radar comme outil de communication

Le graphique radar, qui superpose les résultats de plusieurs évaluations, est un outil de communication puissant. En un coup d’œil, il montre les domaines de force, les zones de faiblesse et la trajectoire de progression. C’est un support idéal pour les rétrospectives, les revues de programme et les discussions avec le management.

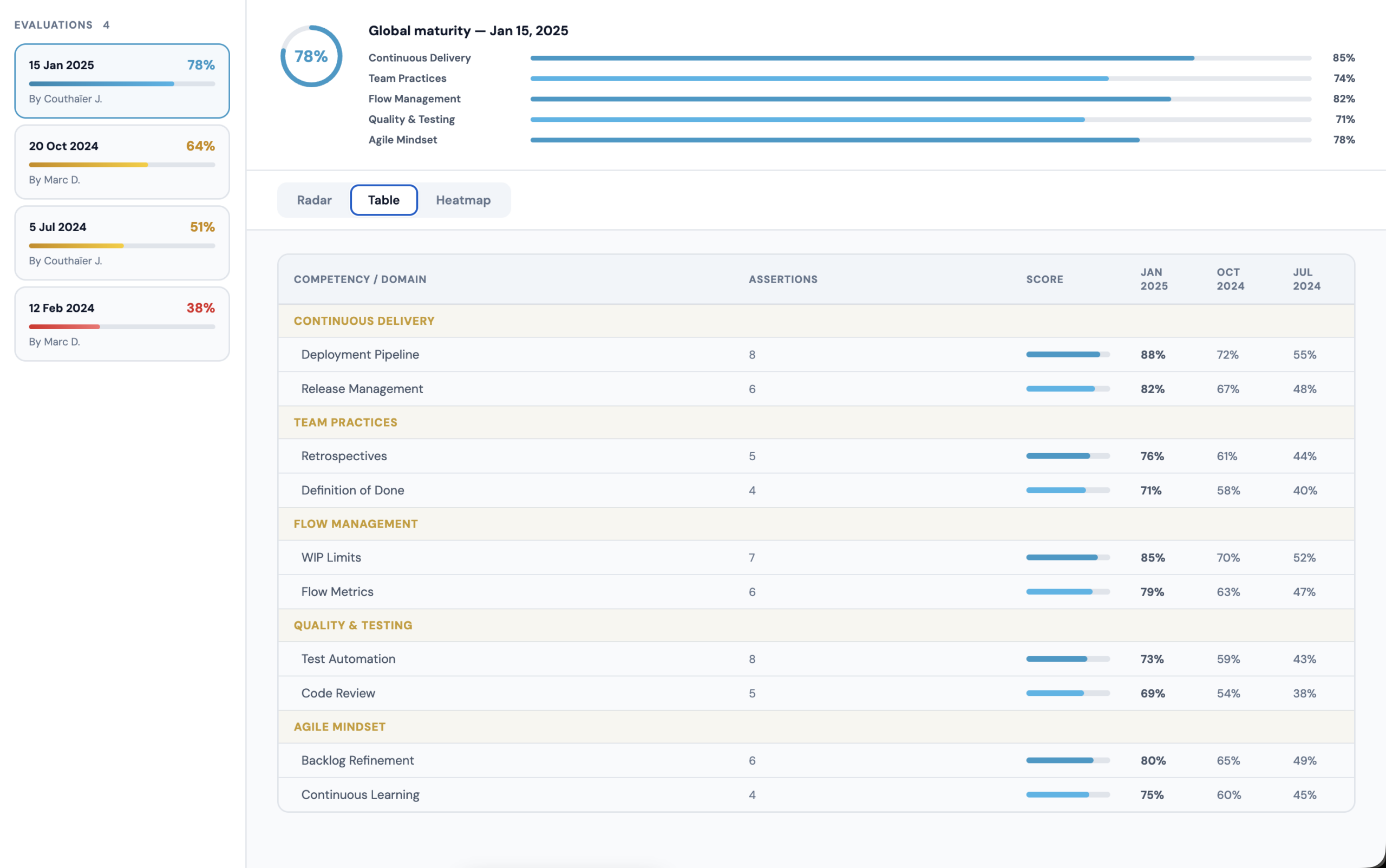

Flow Analytics Pro historise automatiquement chaque évaluation avec sa date. Le graphique radar superpose toutes les évaluations passées, permettant de visualiser instantanément la progression par compétence et par domaine. Vous pouvez comparer l’évaluation la plus récente avec n’importe quelle évaluation précédente. Les scores globaux, par compétence et par domaine, sont calculés automatiquement à chaque mesure. Cette traçabilité transforme l’évaluation d’un exercice ponctuel en un véritable outil de suivi dans le temps.

Étape 5 — Oser la vision portfolio : comparer pour aider

C’est le fameux sujet qui fâche, se comparer ! Pourtant, c’est peut-être le plus important dans une organisation.

Pourquoi la comparaison fait peur

Dans beaucoup d’organisations, comparer les équipes est un tabou.

Mal utilisée, la comparaison peu devenir un classement qui juge et stigmatise les équipes en difficulté, avec l’effet pervers de créer une compétition malsaine entre les équipes.

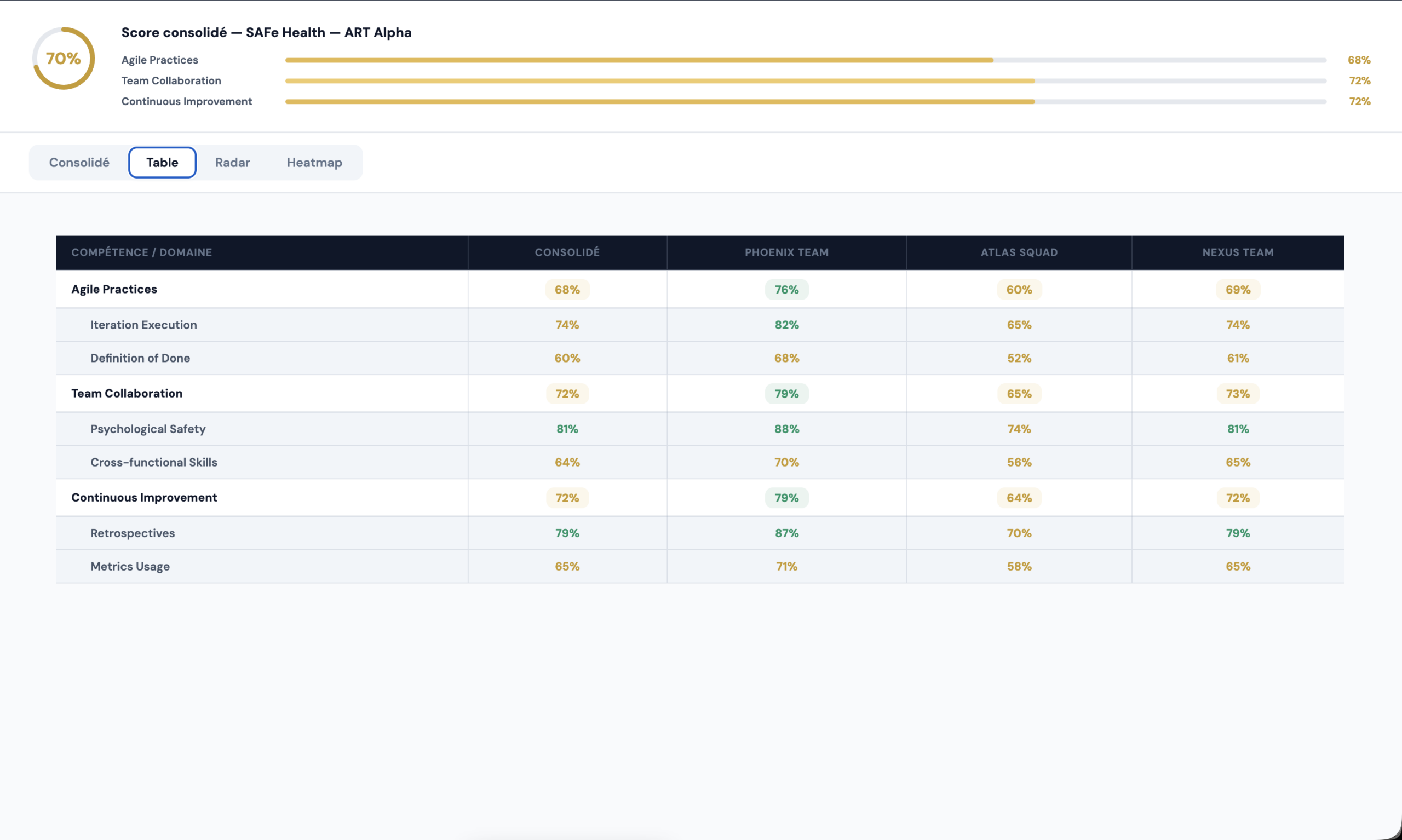

Mais ne pas comparer du tout a un coût tout aussi élevé pour une organisation. Un responsable de transformation qui pilote 20 équipes sans aucune visibilité comparative navigue à l’aveugle. Il ne sait pas quelles équipes ont besoin de coaching, quelles pratiques doivent être améliorée et où investir en formation (technique, fonctionnelle, …).

Comparer ne signifie pas juger, mais comprendre l’état de santé de mon organisation

L’objectif de la vision portfolio n’est pas de désigner les « bonnes » et les « mauvaises » équipes. C’est d’identifier les écarts pour savoir où concentrer l’aide.

Une équipe à 40% de maturité sur ses pratiques de test n’est pas une « mauvaise » équipe. C’est une équipe qui a besoin d’accompagnement sur ce sujet précis. Peut-être que cette même équipe est à 85% sur ses pratiques de collaboration. La comparaison montre le tableau complet.

Le rôle du management dans cette approche

Pour que la comparaison soit acceptée, le management doit avoir une politique claire et transparente sur l’usage qui sera fait des résultats.

- Les résultats servent à allouer de l’aide, pas à sanctionner.

- Chaque équipe est comparée à elle-même avant d’être comparée aux autres.

- Les résultats ne sont jamais utilisés dans les évaluations individuelles.

- Les équipes ont accès aux résultats de toutes les équipes.

Quand ces principes sont posés et respectés, la comparaison devient un levier d’amélioration continue collective. Les équipes les plus avancées sur un domaine peuvent aider celles qui démarrent. Les bonnes pratiques circulent. L’organisation progresse comme un tout, pas comme une collection d’îlots isolés.

Point de vigilance

Ne lancez pas la vision portfolio tant que les équipes ne sont pas à l’aise avec l’auto-évaluation. Commencez par l’étape individuelle (chaque équipe mesure sa propre maturité et travaille sur son plan d’action). La comparaison inter-équipes vient dans un second temps, quand la confiance dans la démarche est établie. Brûler cette étape, c’est prendre le risque que les équipes faussent leurs résultats pour bien paraître.

Flow Analytics Pro permet d’associer chaque évaluation à une équipe ou à un programme. Au niveau programme, vous visualisez l’ensemble des évaluations de toutes les équipes associées, triées par grille de compétences. Le portfolio des évaluations multi-équipes offre une vue consolidée qui permet d’identifier les domaines de force et les zones d’amélioration à l’échelle de l’organisation. Chaque équipe conserve sa propre vue détaillée avec son historique et ses actions, tandis que le management dispose d’une vision transversale pour piloter les investissements en coaching, formation et outillage.

Étape 6 — Croiser les Evaluations avec les Métriques (Flow ; DORA)

Une évaluation mesure des pratiques. Les Flow Metrics et les DORA Metrics mesurent des résultats. La vraie puissance apparaît quand les trois sont associés.

L’évaluation aide à expliquer les métriques

Votre Cycle Time a augmenté de 20% sur le dernier trimestre. Pourquoi ? Les Flow Metrics vous disent que c’est la phase de test qui a ralenti. L’évaluation vous dit que l’équipe est au niveau « Initiation » sur ses pratiques de test automatisé. Le lien est direct : le manque de tests automatisés crée un goulot d’étranglement en phase de test manuel. L’action n’est pas « testez plus vite » mais « investissez dans l’automatisation ».

Les métriques valident l’évaluation

Inversement, les métriques permettent de vérifier si une progression d’évaluation se traduit dans la réalité. Si une équipe passe de « Initiation » à « Adoption » sur ses pratiques CI/CD mais que son Lead Time for Changes ne bouge pas, c’est le signe que la progression déclarée n’est pas encore effective dans la pratique quotidienne.

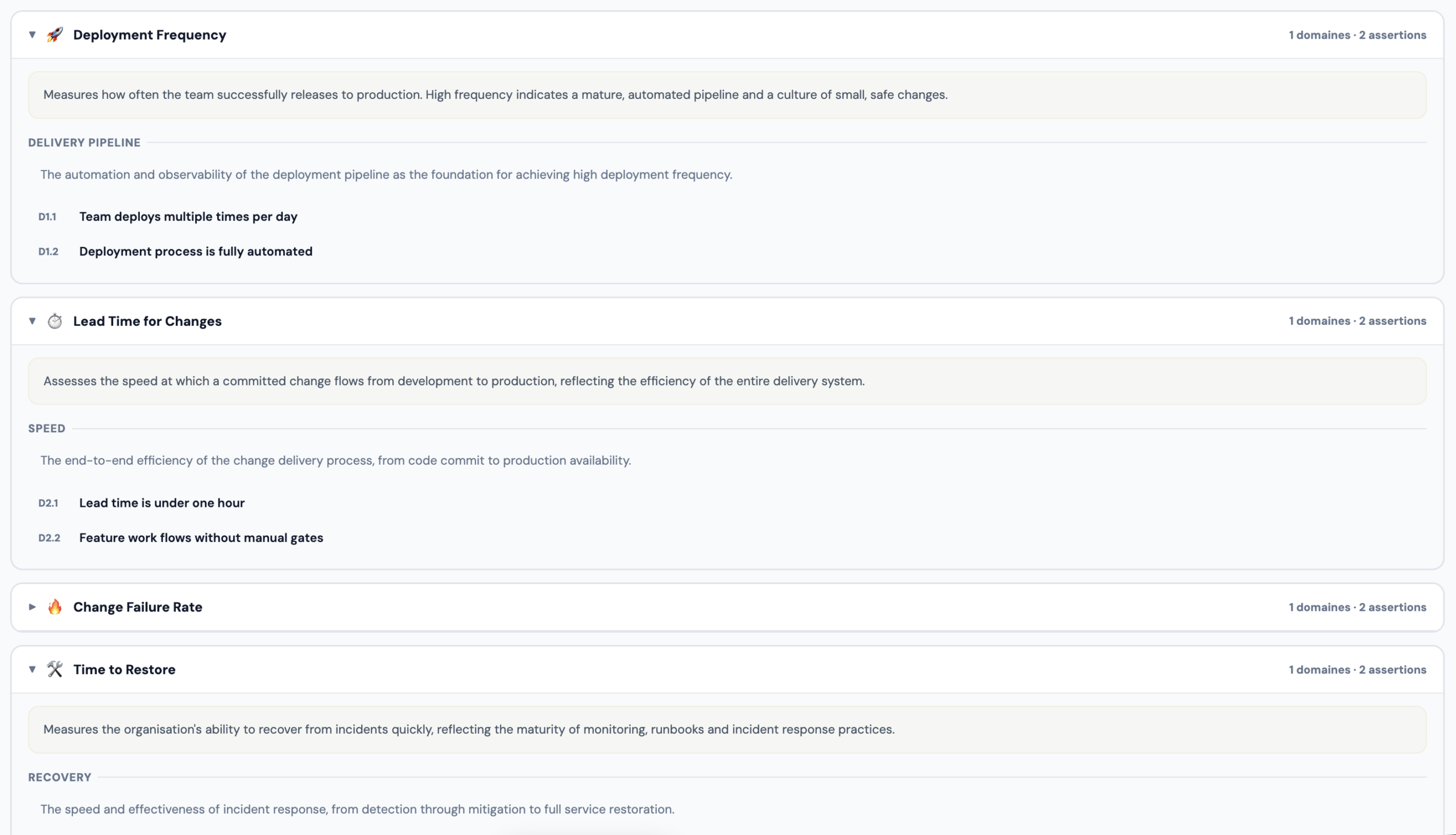

DORA Metrics + DORA Capabilities : l’exemple parfait

La combinaison la plus puissante est celle des DORA Metrics (fréquence de déploiement, Lead Time for Changes, Change Failure Rate, Time to Restore Service) avec l’évaluation des DORA Capabilities. Les Capabilities sont les pratiques (CI, CD, trunk-based development, monitoring, architecture faiblement couplée) qui, selon la recherche DORA, sont corrélées à l’amélioration des métriques.

Si votre fréquence de déploiement est au niveau « Low » et que votre évaluation des Capabilities montre un faible niveau en intégration continue et en déploiement automatisé, le plan d’action se dessine de lui-même. Ce n’est plus de l’intuition : c’est un diagnostic fondé sur les données et validé par la recherche.

Flow Analytics Pro est conçu précisément pour ce croisement. Une évaluation peut être associée à ses Flow Metrics et à une DORA Metrics . Vous disposez ainsi, dans une même plateforme, de la performance mesurée (ce que l’équipe produit) et de la maturité évaluée (comment l’équipe travaille). Alice, l’IA intégrée, peut analyser cette combinaison pour identifier les leviers d’amélioration les plus impactants. C’est cette vision unifiée, métriques + évaluations dans un même outil, qui fait la différence entre mesurer et réellement piloter l’amélioration.

Conclusion

Mesurer la maturité de ses équipes n’est pas un exercice compliqué. Le plus dur, c’est de commencer !

Une fois la première évaluation faite, l’équipe voit immédiatement l’intérêt : elle sait où elle en est, elle sait sur quoi travailler, et elle peut mesurer ses progrès. C’est concret et motivant.

Quant à la comparaison entre équipes, elle n’a rien d’effrayant si l’intention est claire – aider celles qui en ont besoin, partager ce qui marche, progresser ensemble. C’est aussi simple que ça.

Prêt à évaluer la maturité de vos équipes ?

Flow Analytics Pro intègre un module complet d’Evaluations, avec historisation, radar et plans d’action.